こんにちは、ダルマBです👺

最近、OpenAI社の「CLIP」っていうAIモデルを知りました。

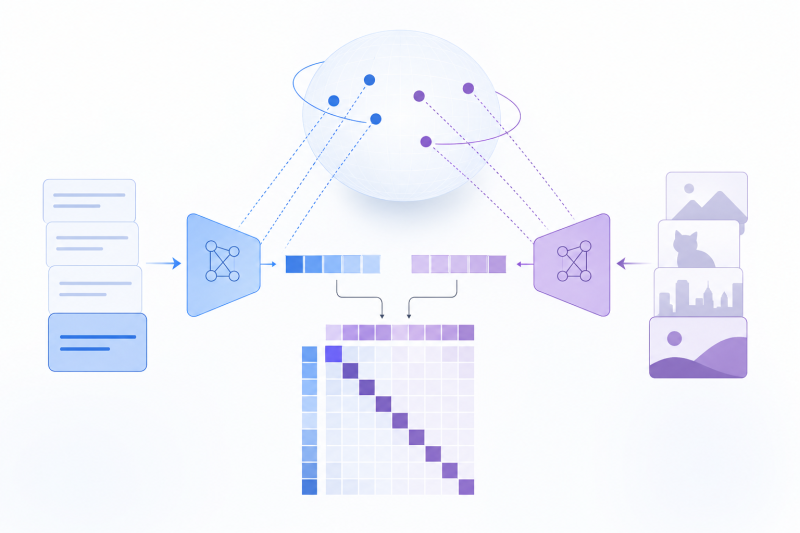

CLIPは、画像とテキストの“意味の近さ”を見てくれるモデルです。

つまり、カメラ映像に対して

「熊がいる」「人が倒れている」みたいな文章を投げると、

どれくらい当てはまるかを数値で出してくれます。

ということで、

👉「質問したら答えてくれるカメラ、作れるのでは?」

つぶやくカメラは、AIが勝手に状況を説明してくれる仕組みでしたが、

今回は逆で、

👉人が質問して、AIがYES/NOで答えるカメラです。

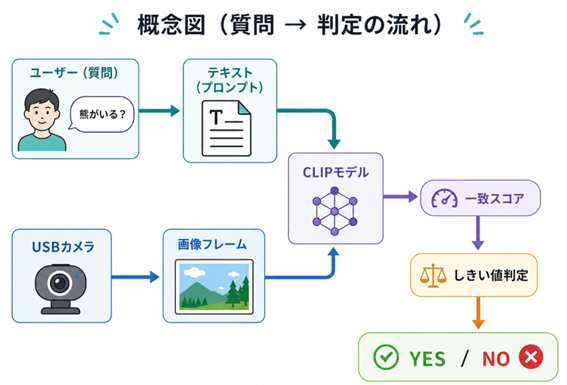

◆今回考えている「YES/NOカメラ」の構成

①USBカメラで映像取得

②CLIPで画像と質問テキストを比較

③スコアに応じてYES / NOを判定

◆概念図(質問 → 判定の流れ)

ここに、DeepX社のモジュールを組み合わせれば、

👉エッジでサクッと答えてくれるAIカメラになるのでは?と考えています。

もし実現できたら、

・熊の出没チェック

・転倒の検知

・火災の初期検知

みたいな“未然防止”に使えるのでは?

ということで、忙しい部下たちにデモを作ってもらうように説得してみます。

続く